يكشنبه ۸ جولای ۱۸

هوش مصنوعی و یادگیری ماشین (Machine Learning) از موارد است که سال های آتی نمونه های بی شماری از کاربری آن ها را در زندگی خواهیم دید. با حجم وسیعی از اطلاعات شخصی که هر روز ما کاربران با دست خود در انواع شبکه های اجتماعی در جهت کار، سرگرمی، مصارف شخصی یا حتی دوست یابی منتشر می کنیم، خوراک یادگیری ماشین (Machine Learning) را تامین می کنیم.در ادامه همراه با عبیاتی باشید.

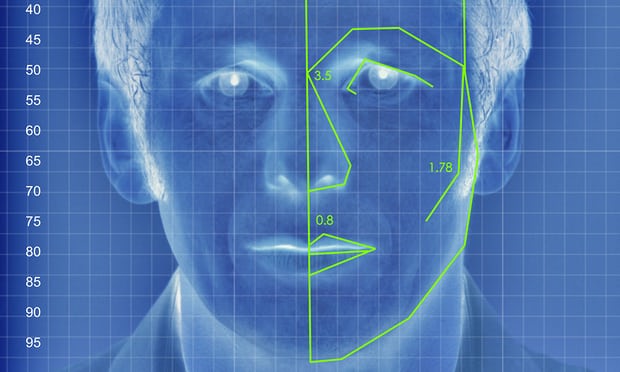

امروز گزارش از گاردین منتشر شده که می گوید هوش مصنوعی از روی عکس میل جنسی افراد (جنسیت) را تشخیص می دهد! فقط از روی عکس شما! عکسی که حداقل هر کدام از ما چندین عدد در انواع شبکه های اجتماعی از خود داریم!

با توجه به تحقیقات جدید که نشان می دهد ماشین (ربات) می توانند به طور قابل توجهی بهتر از “گیدر” (سایت دوست یابی افراد گی (Gay)) نسبت به انسان ها باشند، هوش مصنوعی می تواند با دقت حدس بزند آیا افراد همجنسگرا یا عادی هستند آن هم فقط از روی عکس های چهره هایشان!

مطالعات دانشگاه استنفورد نشان داد که الگوریتم کامپیوتری می تواند به طور صحیح بین مردان با گرایش عادی مردانه و همجنسگرایان 81٪ و 74٪ برای زنان تشخیص دهد. این گزارش سوالاتی در مورد ریشه های بیولوژیکی گرایش جنسی، اخلاق تکنولوژی تشخیص چهره و پتانسیل این نوع نرم افزار برای نقض حریم خصوصی افراد یا برای اهداف ضد LGBT مورد سوء استفاده قرار گرفته است، ایجاد می کند. اگر می پرسید LGBT چیست باید بگوییم، معادل انگلیسی دگرباش سرواژهLGBT است که اختصاری از Gay ,Lesbian ,Bisexual و Transgender است.

دگرباش از دو بخش دگر وباش تشکیل شدهاست. واژه دگر دگرگون یافته واژه دیگر و واژه باش از ریشه باشیدن به معنای بودن یا زیستن است و شامل افرادی است که گرایش جنسی و رفتار جنسی متفاوت از دگرجنسگرایی دارند که شامل همجنسگرایی مردانه، همجنسگرایی زنانه ،دوجنسگرایی و دگرجنس گونه گان است. [ویکی پدیا]

هوش مصنوعی مورد آزمایش در تحقیق که در مجله روانشناسی فردی و اجتماعی منتشر شد و در ابتدا در Economist گزارش شد، بر اساس نمونه ای از بیش از 35،000 تصویر صورت که مردان و زنان به طور عمومی در یک وب سایت دوست یابی (Dating) ایالات متحده منتشر شده است، کار می کند. محققان، میچال کاسیسینسکی و ییلون وانگ، ویژگی های تصاویر را با استفاده از “شبکه های عصبی عمیق” استخراج کرده اند، به این معنی یک سیستم ریاضی پیچیده است که تجزیه و تحلیل تصاویر بر اساس مجموعه داده های بزرگ را می آموزد.

این تحقیق نشان داد مردان و زنان همجنسگرا تمایل دارند ویژگی ها، اصطلاحات و سبک های گرایش جنسی “غیر جنسیتی” داشته باشند که عمدتا به معنی مردان همجنس گرا ظاهری زنانه هستند و برای زنان همجنس گرا بالعکس است. داده ها همچنین روند مشخصی را شناسایی کردند، از جمله اینکه مردان همجنس گرا، فک ها باریک، بینی های طولانی و پیشانی های بزرگتری نسبت به مردان عادی داشتند، و زنان همجنسگرا دارای فک های بزرگتر و پیشانی های کوچکتر نسبت به زنان عادی بود.

قضات انسانی درباره افراد همجنس گرا خیلی بدتر از الگوریتم عمل کردند

قضات انسانی خیلی بدتر از الگوریتم عمل کردند، فقط 61 درصد از اوقات برای مردان و 54 درصد برای زنان تعیین می شود. هنگامی که نرم افزار پنج عکس را برای هر فرد بررسی کرد، حتی بیشتر موفق بود – 91٪ از زمان با مردان و 83٪ با زنان! نویسنده می گوید به طور گسترده، به این معنی است که “چهره ها حاوی اطلاعات بسیار بیشتری درباره گرایش جنسی هستند تا اینکه مغز انسان آنها را درک و تفسیر می کند”.

افراد پیش از تولد همجنس گرا هستند و عجیب بودن یک انتخاب نیست

این مقاله نشان داد که یافته ها “حمایت قوی” را برای این نظریه که گرایش جنسی به دلیل قرار گرفتن در معرض هورمون های خاص قبل از تولد است، به وجود می آورد، بدین معنی است که افراد پیش از تولد همجنس گرا هستند و عجیب بودن یک انتخاب نیست. میزان موفقیت پایین تر این دستگاه برای زنان نیز می تواند از این نکته حمایت کند که گرایش جنسی زن شناورتر است.

در حالی که یافته ها در مورد جنسیت و جنسیت محدودیت های واضح دارد (افراد رنگی در این مطالعه قرار نگرفتند و در مورد افراد غیر متعارف و دوجنسگرا مورد توجه قرار نگرفتند)، پیامدهای هوش مصنوعی (AI) گسترده و هشدار دهنده است. محققان با ارائه میلیاردها تصویر صورت از افراد ذخیره شده در سایت های رسانه های اجتماعی و در پایگاه های دولتی، می گویند که داده های عمومی می تواند برای شناسایی جهت گیری جنسی افراد بدون رضایت آنها مورد استفاده قرار گیرد.

آسان است تصور کنید که همسران با استفاده از تکنولوژی در شرکایی که مشکوک هستند یا نوجوانانی که از الگوریتم برای خودشان یا همتایان خود استفاده می کنند. این وقتی بیشتر تهدیدآمیز است که دولتهایی که همچنان به محاکمه افراد مبتلا به LGBT ادامه می دهند، می توانند از تکنولوژی استفاده کنند و مردم را هدف قرار دهند. این بدان معنی است که این ساخت نوع نرم افزار ها و افشای آن به خودی خود بحث برانگیز به نظر می رسد که می تواند برنامه های مضر را تشویق کند.

اما سازندگان اظهار داشتند که این تکنولوژی در حال حاضر وجود دارد و قابلیت های آن برای افشای مهم است، به طوری که دولت ها و شرکت ها می توانند به طور فعالانه خطرات حفظ حریم خصوصی و نیاز به حفاظت و مقررات را در نظر بگیرند.

“قطعا ناامید کننده است. نیک رایت، استاد رشته روانشناسی دانشگاه تورنتو، که تحقیق در مورد همجنسگرایان را منتشر کرده است می گوید: مانند هر ابزار جدید، اگر به دست اشتباه راه پیدا کند، می تواند برای اهداف بد استفاده شود. اگر شما می توانید مردم را بر اساس ظاهر خود دسته بندی کنید، سپس آنها را شناسایی و چیزهای وحشتناکی به آنها بدهید، واقعا بد است”.

قانون مدعی شد که هنوز هم این تکنولوژی را توسعه داده و آزمایش می کند: «آنچه که سازندگان در اینجا انجام داده اند این است که بیانیه ای بسیار جنجالی درباره این که این توانایی چه قدر می تواند دقیقا باشد داده اند. اکنون می دانیم که ما نیاز به مراقبت داریم. ”

کوسینسکی برای نظر دادن بلافاصله در دسترس نبود، اما پس از انتشار این مقاله در روز جمعه، او با گاردین درباره اخلاق تحقیق و پیامدهای حقوق همجنسگرایان صحبت کرد. پروفسوری که برای کار خود با دانشگاه کمبریج در زمینه روان سنجی شناخته شده است، از جمله استفاده از داده های فیس بوک برای نتیجه گیری در مورد شخصیت افراد. کمپین دونالد ترامپ و طرفداران Brexit ابزار مشابهی را برای هدف قرار دادن رای دهندگان توسعه دادند که افزایش نگرانی در مورد استفاده گسترده از داده های شخصی در انتخابات را سبب شد.

در مطالعات استنفورد، سازندگان همچنین اشاره کردند که هوش مصنوعی می تواند برای کشف ارتباط بین ویژگی های صورت و طیف وسیعی از پدیده های دیگر مانند دیدگاه های سیاسی، شرایط روحی یا شخصیت استفاده شود.

ین نوع تحقیق بیشتر باعث نگرانی در مورد پتانسیل هایی برای سناریوهایی مانند گزارش علمی تخیلی “گزارش اقلیت” می شود که در آن افراد دستگیر می شوند و این تنها بر اساس پیش بینی های انجام شده برای اینکه آن ها جرم مرتکب شوند، است.

هوش مصنوعی (AI) می تواند هر چیزی را درباره هر کسی که اطلاعات کافی از او وجود داشته باشد، به شما بگوید

براون Brackeen، مدیر عامل شرکت Kairos، یک شرکت تشخیص چهره، گفت: “هوش مصنوعی (AI) می تواند هر چیزی را درباره هر کسی که اطلاعات کافی از او وجود داشته باشد، به شما بگوید. این سوال به عنوان یک جامعه است، آیا ما می خواهیم بدانیم؟” او گفته است که داده های استنفورد در مورد گرایش جنسی “به طرز ناگواری صحیح است”. به عقیده وی نیاز به افزایش توجه به حریم خصوصی و ابزار برای جلوگیری از سوء استفاده از یادگیری ماشین است ، زیرا یادگیری ماشین هر روز گسترده تر و پیشرفته تر می شود.

یادگیری ماشین هر روز گسترده تر و پیشرفته تر می شود

قانون در مورد AI مورد استفاده قرار گرفته است که به طور فعالانه بر اساس تفسیر ماشین از چهره آنها علیه مردم تبعیض قائل می شود: “همه ما باید همه چیز را مورد توجه قرار دهیم.”

به صورت کلی باید توجه داشته باشیم که چه میزان از اطلاعات شخصی خود را به صورت عمومی منتشر می کنیم، از تصاویر تا اطلاعاتی درباره گذشته، حال و آینده! شما درباره هوش مصنوعی و یادگیری ماشین چطور فکر می کنید؟